【Pratica】Compressione PDF senza perdita: Soluzione di ottimizzazione strutturale basata su PyMuPDF

【Pratica】Compressione PDF senza perdita: Soluzione di ottimizzazione strutturale basata su PyMuPDF

Nel lavoro quotidiano, ci troviamo spesso di fronte al problema delle dimensioni eccessive dei file PDF: limiti di dimensione degli allegati e-mail, velocità di caricamento e download lente, occupazione di spazio di archiviazione. I metodi di compressione tradizionali riducono la qualità delle immagini causando sfocature o trasformano il testo in immagini perdendo la ricercabilità, risultando quindi poco pratici.

Oggi voglio condividere con voi una soluzione di compressione PDF senza perdita — ottimizzando la struttura interna del PDF e pulendo i dati ridondanti utilizzando la libreria PyMuPDF (fitz), in grado di ridurre efficacemente le dimensioni del file mantenendo perfettamente la ricercabilità del testo e la chiarezza visiva.

I. Principio di implementazione centrale

Ecco il codice centrale, che rappresenta la logica chiave per l'ottimizzazione e la compressione della struttura PDF:

import os

from pathlib import Path

import fitz # PyMuPDF

def compress_pdf_simple(input_path, output_path=None):

"""

Metodo di compressione PDF semplice - solo ottimizzazione della struttura (senza perdita)

Parametri:

input_path (str): Percorso del file PDF di input

output_path (str): Percorso del file PDF di output

Ritorna:

str: Percorso del file di output

"""

try:

# Apri il file PDF

doc = fitz.open(input_path)

# Genera intelligentemente il percorso di output (se non specificato)

if output_path is None:

input_file = Path(input_path)

output_path = str(input_file.parent / f"{input_file.stem}_simple_compressed{input_file.suffix}")

# Centrale: implementa la compressione senza perdita tramite combinazione di parametri

doc.save(

output_path,

garbage=4, # Pulisci al massimo gli oggetti non utilizzati

deflate=True, # Utilizza l'algoritmo di compressione senza perdita deflate

clean=True, # Pulisci/ottimizza la struttura interna del PDF

pretty=False # Output compatto, rimuovi caratteri bianchi

)

# Chiudi il documento per liberare risorse

doc.close()

# Calcola le informazioni sulla compressione

original_size = os.path.getsize(input_path)

compressed_size = os.path.getsize(output_path)

compression_ratio = (1 - compressed_size / original_size) * 100

# Stampa i risultati della compressione

print(f"✅ Compressione semplice completata!")

print(f"📄 File originale: {input_path} ({original_size / 1024 / 1024:.2f} MB)")

print(f"📦 File compresso: {output_path} ({compressed_size / 1024 / 1024:.2f} MB)")

print(f"📉 Tasso di compressione: {compression_ratio:.1f}%")

print(f"🔍 Mantenere la ricercabilità del testo: Sì")

return output_path

except Exception as e:

print(f"❌ Si è verificato un errore durante la compressione: {str(e)}")

return None

# Esempio di chiamata

# compress_pdf_simple("tuo_file.pdf")

Il cuore di questa soluzione è l'utilizzo del metodo save() di PyMuPDF con 4 parametri chiave, che ottimizzano la "snellimento" del PDF senza modificare il contenuto del documento stesso.

II. Analisi approfondita dei parametri chiave

2.1 garbage=4: Pulizia precisa degli oggetti "orfani"

All'interno dei file PDF ci sono molti oggetti indiretti (pagine, font, immagini, annotazioni, ecc.), e quando si modifica il documento, la rimozione del contenuto non pulisce immediatamente i riferimenti sottostanti, causando l'accumulo di molti "oggetti orfani".

| Valore del parametro garbage | Livello di pulizia | Scenari applicabili |

|---|---|---|

| 0 | Nessuna pulizia | Solo salvataggio rapido, senza compressione |

| 1 | Pulizia di oggetti non utilizzati evidenti | Ottimizzazione leggera, priorità alla compatibilità |

| 2 | Controllo approfondito delle relazioni di riferimento | Ottimizzazione regolare, equilibrio tra effetto e sicurezza |

| 3 | Pulizia aggressiva | Massimizzazione della compressione per file PDF semplici |

| 4 | Massima pulizia | Documenti modificati più volte, necessità di verificare l'integrità |

Flusso d'azione: Scansione di tutti gli oggetti indiretti → Creazione di un grafo delle relazioni di riferimento → Rimozione degli oggetti senza riferimenti → Liberazione dello spazio di archiviazione. Effetto reale: Documenti modificati più volte possono ridurre le dimensioni del 10-30%.

2.2 deflate=True: Algoritmo di compressione senza perdita universale

Deflate è l'algoritmo di compressione senza perdita raccomandato dalle specifiche PDF (basato su LZ77 + codifica Huffman), con massima compatibilità, praticamente tutti i lettori PDF possono decodificarlo.

Una volta attivato, comprimerà questi oggetti:

- Flussi di contenuto delle pagine

- Flussi di dati dei font

- Flussi di dati delle immagini non compressi da altri algoritmi

2.3 clean=True: Ottimizzazione della struttura del documento

Il PDF contiene due parti: "struttura del documento" e "flusso di contenuto", clean=True ottimizza specificamente la parte strutturale:

- Rimuove oggetti PDF duplicati

- Unisce riferimenti a oggetti con contenuti identici

- Ottimizza la struttura dell'albero delle pagine

- Pulisce informazioni ridondanti nei metadati

Effetto reale: Documenti multi-pagina possono ridurre le dimensioni del 5-15%.

2.4 pretty=False: Output compatto

Il PDF è essenzialmente un formato binario, pretty=True manterrà indentazioni, nuove righe e altri caratteri bianchi per migliorare la leggibilità, mentre pretty=False rimuoverà tutti i caratteri bianchi non necessari, riducendo ulteriormente le dimensioni (effetto ausiliario per i file già compressi con deflate, ma comunque utile).

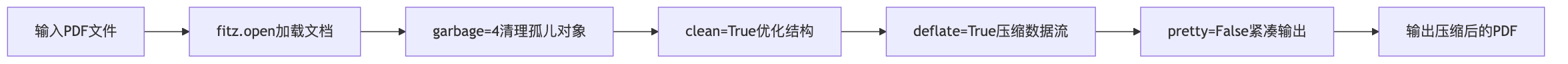

III. Flusso di compressione completo

IV. Difficoltà tecniche e soluzioni

4.1 Tasso di compressione vs integrità del documento

Sfida: La raccolta dei rifiuti aggressiva (garbage=4) potrebbe danneggiare PDF complessi (contenenti script/moduli). Soluzioni:

- Verificare l'integrità del documento prima della compressione

- PDF crittografati devono essere decrittografati prima della compressione

- Utilizzare try-except per catturare eccezioni, evitando il crash del programma

4.2 Mantenere la ricercabilità del testo

Sfida: Alcuni metodi di compressione possono trasformare il testo in immagini, rendendo impossibile la selezione/ricerca. Vantaggi di questa soluzione:

- Non modifica il contenuto e la codifica del testo

- Ottimizza solo le relazioni di riferimento degli oggetti

- Mantiene l'integrità degli oggetti font

- Metodo di verifica: testare la funzionalità di selezione del testo con un lettore PDF dopo la compressione

4.3 Gestione della memoria per file di grandi dimensioni

Sfida: PDF di centinaia di MB possono facilmente causare overflow di memoria. Suggerimenti per l'ottimizzazione:

- Elaborazione a pagine per file di grandi dimensioni

- Chiudere tempestivamente l'oggetto doc per liberare risorse

- Monitorare l'uso della memoria, adottare un'elaborazione a flusso

4.4 Generazione intelligente del percorso di output

Utilizzare la libreria pathlib per generare automaticamente il percorso, mantenendo il nome del file originale + il segno di compressione, compatibile su più piattaforme:

if output_path is None:

input_file = Path(input_path)

output_path = str(input_file.parent / f"{input_file.stem}_simple_compressed{input_file.suffix}")

V. Scenari di utilizzo e stime degli effetti

5.1 Scenari applicabili

- Documenti accademici: i PDF scaricati da arXiv contengono spesso molte informazioni ridondanti

- Archiviazione di eBook: risparmio di spazio di archiviazione dopo la compressione

- Trasferimento di documenti: pre-elaborazione prima del caricamento su e-mail/cloud

- Elaborazione in batch: implementazione di compressione automatizzata con Celery

5.2 Stime degli effetti

| Tipo di documento | Tasso di compressione tipico | Note |

|---|---|---|

| Documenti di solo testo | 10-25% | Effetto più evidente |

| Contenente molte immagini | 5-15% | Solo ottimizzazione strutturale |

| Documenti modificati più volte | 20-40% | Effetto significativo della raccolta dei rifiuti |

| PDF scansionati | 0-5% | Già in formato immagine, ottimizzazione limitata |

5.3 Note

- Eseguire il backup del file originale: la compressione è irreversibile

- Verificare l'integrità del contenuto: controllare completamente dopo la compressione

- Testare l'effetto di stampa: evitare di influenzare l'output

- Per elaborazioni di grandi dimensioni, si consiglia di utilizzare un'architettura distribuita

VI. Confronto con soluzioni simili

| Soluzione di compressione | Tasso di compressione | Perdita di qualità | Ricercabilità del testo | Complessità di implementazione |

|---|---|---|---|---|

| Ottimizzazione della struttura PyMuPDF | 10-30% | Nessuna | Mantenuta | Bassa |

| Compressione con riduzione della qualità delle immagini | 30-70% | Evidente | Mantenuta | Media |

| Ricodifica PDF | 20-50% | Possibile perdita | Possibile perdita | Alta |

VII. Suggerimenti per l'ottimizzazione delle prestazioni

- Elaborazione in batch: utilizzare la concorrenza multi-processo per elaborare più file, aumentando l'efficienza

- Monitoraggio del progresso: aggiungere funzioni di callback per il progresso, migliorando l'esperienza utente

- Compressione incrementale: comprimere solo le pagine modificate del PDF, riducendo le operazioni ripetute

- Meccanismo di caching: registrare i file già compressi, evitando elaborazioni ripetute

VIII. Conclusione

Riepilogo dei punti chiave

- Questa soluzione si basa sui quattro parametri chiave di PyMuPDF:

garbage=4,deflate=True,clean=True,pretty=False, per realizzare la compressione PDF senza perdita; - I vantaggi della soluzione sono che non compromette la qualità del documento, mantiene la ricercabilità del testo, ed è semplice da implementare e altamente compatibile;

- Gli effetti della compressione variano notevolmente a seconda del tipo di PDF, l'ottimizzazione è limitata per i documenti scansionati, mentre i documenti di solo testo modificati più volte mostrano i migliori risultati.

Questa soluzione di compressione PDF senza perdita bilancia praticità e sicurezza, con codice semplice e facile integrazione, adatta alla maggior parte degli scenari di elaborazione documentale. Se è necessaria una compressione più elevata, è possibile combinare questa soluzione con la compressione senza perdita delle immagini (ad esempio, ottimizzando la DPI), ma è necessario prestare attenzione all'equilibrio tra effetto e complessità.