【实战】PDF无损压缩:基于PyMuPDF的结构优化方案

【实战】PDF无损压缩:基于PyMuPDF的结构优化方案

Dalam pekerjaan sehari-hari, kita sering menghadapi masalah ukuran file PDF yang terlalu besar: ukuran lampiran email terbatas, kecepatan unggah dan unduh lambat, dan memakan banyak ruang penyimpanan. Metode kompresi tradisional baik mengurangi kualitas gambar yang menyebabkan kabur, atau mengubah teks menjadi gambar yang kehilangan kemampuan pencarian, yang benar-benar tidak sebanding.

Hari ini saya akan membagikan solusi kompresi PDF tanpa kehilangan — mengoptimalkan struktur internal PDF menggunakan pustaka PyMuPDF (fitz), membersihkan data redundan, yang dapat secara efektif mengurangi ukuran file dan dengan sempurna mempertahankan kemampuan pencarian teks dan kejernihan visual.

一、核心实现原理

Mari kita lihat kode inti, ini adalah logika kunci untuk mengoptimalkan dan mengompresi struktur PDF:

import os

from pathlib import Path

import fitz # PyMuPDF

def compress_pdf_simple(input_path, output_path=None):

"""

Metode kompresi PDF sederhana - hanya melakukan optimasi struktur (tanpa kehilangan)

Parameter:

input_path (str): Jalur file PDF input

output_path (str): Jalur file PDF output

Kembali:

str: Jalur file output

"""

try:

# Buka file PDF

doc = fitz.open(input_path)

# Ciptakan jalur output secara cerdas (jika tidak ditentukan)

if output_path is None:

input_file = Path(input_path)

output_path = str(input_file.parent / f"{input_file.stem}_simple_compressed{input_file.suffix}")

# Inti: Melalui kombinasi parameter untuk mencapai kompresi tanpa kehilangan

doc.save(

output_path,

garbage=4, # Membersihkan objek yang tidak digunakan sebanyak mungkin

deflate=True, # Menggunakan algoritma kompresi tanpa kehilangan deflate

clean=True, # Membersihkan/mengoptimalkan struktur internal PDF

pretty=False # Output kompak, menghapus karakter kosong

)

# Tutup dokumen untuk membebaskan sumber daya

doc.close()

# Hitung informasi kompresi

original_size = os.path.getsize(input_path)

compressed_size = os.path.getsize(output_path)

compression_ratio = (1 - compressed_size / original_size) * 100

# Output hasil kompresi

print(f"✅ Kompresi sederhana selesai!")

print(f"📄 File asli: {input_path} ({original_size / 1024 / 1024:.2f} MB)")

print(f"📦 File terkompresi: {output_path} ({compressed_size / 1024 / 1024:.2f} MB)")

print(f"📉 Rasio kompresi: {compression_ratio:.1f}%")

print(f"🔍 Mempertahankan kemampuan pencarian teks: Ya")

return output_path

except Exception as e:

print(f"❌ Terjadi kesalahan selama proses kompresi: {str(e)}")

return None

# Contoh pemanggilan

# compress_pdf_simple("file_anda.pdf")

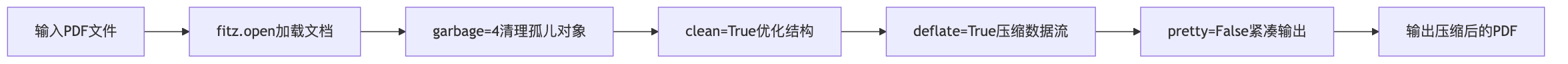

Inti dari solusi ini adalah memanfaatkan metode save() dari PyMuPDF dengan 4 parameter kunci, melalui kombinasi optimasi untuk "mengurangi berat" PDF, dan tidak mengubah konten dokumen itu sendiri.

二、关键参数深度解析

2.1 garbage=4:精准清理“孤儿”对象

Di dalam file PDF terdapat banyak objek tidak langsung (halaman, font, gambar, komentar, dll.), saat mengedit dokumen, menghapus konten tidak segera membersihkan referensi dasar, menyebabkan banyak "objek yatim" menumpuk.

| Nilai parameter garbage | Tingkat pembersihan | Skenario penggunaan |

|---|---|---|

| 0 | Tidak membersihkan | Hanya perlu menyimpan cepat, tidak perlu kompresi |

| 1 | Membersihkan objek yang jelas tidak digunakan | Optimasi ringan, prioritas pada kompatibilitas |

| 2 | Memeriksa hubungan referensi secara mendalam | Optimasi umum, menyeimbangkan efek dan keamanan |

| 3 | Pembersihan agresif | Memaksimalkan kompresi untuk file PDF sederhana |

| 4 | Pembersihan maksimal | Dokumen yang telah diedit berkali-kali, perlu memverifikasi integritas |

Proses kerja: Menelusuri semua objek tidak langsung → Membangun grafik hubungan referensi → Menghapus objek tanpa referensi → Membebaskan ruang penyimpanan. Efek nyata: Dokumen yang telah diedit berkali-kali dapat mengurangi ukuran 10-30%.

2.2 deflate=True:通用无损压缩算法

Deflate adalah algoritma kompresi tanpa kehilangan yang direkomendasikan oleh spesifikasi PDF (berbasis LZ77 + pengkodean Huffman), dengan kompatibilitas yang tinggi, hampir semua pembaca PDF dapat mendekode.

Setelah diaktifkan, objek-objek berikut akan dikompresi:

- Aliran konten halaman

- Aliran data font

- Aliran data gambar yang tidak dikompresi oleh algoritma lain

2.3 clean=True:优化文档结构

PDF terdiri dari dua bagian "struktur dokumen" dan "aliran konten", clean=True secara khusus mengoptimalkan bagian struktur:

- Menghapus objek PDF yang duplikat

- Menggabungkan referensi objek dengan konten yang sama

- Mengoptimalkan struktur pohon halaman

- Membersihkan informasi metadata yang redundan

Efek nyata: Dokumen multi-halaman dapat mengurangi ukuran 5-15%.

2.4 pretty=False:紧凑输出

PDF pada dasarnya adalah format biner, pretty=True akan mempertahankan indentasi, baris baru, dan karakter kosong lainnya untuk meningkatkan keterbacaan, pretty=False akan menghapus semua karakter kosong yang tidak perlu, lebih lanjut mengurangi ukuran (efek tambahan untuk file yang sudah terkompresi dengan deflate, tetapi tetap bermanfaat).

三、完整压缩流程

四、技术难点与解决方案

4.1 压缩率 vs 文档完整性

Tantangan: Pembersihan sampah yang agresif (garbage=4) dapat merusak PDF yang kompleks (termasuk skrip/formulir). Solusi:

- Verifikasi integritas dokumen sebelum kompresi

- PDF yang dienkripsi perlu didekripsi sebelum dikompresi

- Gunakan try-except untuk menangkap pengecualian, menghindari program crash

4.2 保持文本可搜索性

Tantangan: Beberapa solusi kompresi akan mengubah teks menjadi gambar, menyebabkan tidak dapat dipilih/cari. Keunggulan solusi ini:

- Tidak mengubah konten dan pengkodean teks

- Hanya mengoptimalkan hubungan referensi objek

- Mempertahankan integritas objek font

- Metode verifikasi: Uji fungsi pemilihan teks setelah kompresi menggunakan pembaca PDF

4.3 大文件内存管理

Tantangan: PDF berukuran ratusan MB dapat menyebabkan kelebihan memori. Saran optimasi:

- Proses file besar secara bertahap

- Segera tutup objek doc untuk membebaskan sumber daya

- Pantau penggunaan memori, gunakan pemrosesan aliran

4.4 智能生成输出路径

Menggunakan pustaka pathlib untuk secara otomatis menghasilkan jalur, mempertahankan nama file asli + tanda kompresi, kompatibilitas lintas platform:

if output_path is None:

input_file = Path(input_path)

output_path = str(input_file.parent / f"{input_file.stem}_simple_compressed{input_file.suffix}")

五、使用场景与效果预估

5.1 适用场景

- Dokumen akademis: PDF yang diunduh dari arXiv biasanya mengandung banyak informasi redundan

- Arsip e-book: Menghemat ruang penyimpanan setelah dikompresi

- Pengiriman dokumen: Pra-pemrosesan sebelum mengunggah ke email/cloud

- Pemrosesan batch: Menggabungkan Celery untuk otomatisasi kompresi

5.2 效果预估

| Tipe Dokumen | Rasio Kompresi Tipikal | Catatan |

|---|---|---|

| Dokumen teks murni | 10-25% | Efek paling jelas |

| Mengandung banyak gambar | 5-15% | Hanya mengandalkan optimasi struktur |

| Dokumen yang telah diedit berkali-kali | 20-40% | Efek pembersihan sampah yang signifikan |

| PDF hasil scan | 0-5% | Sudah dalam format gambar, optimasi terbatas |

5.3 注意事项

- Cadangkan file asli: Kompresi tidak dapat dibalik

- Verifikasi integritas konten: Periksa secara menyeluruh setelah kompresi

- Uji hasil cetak: Hindari mempengaruhi output

- Untuk pemrosesan dalam jumlah besar, disarankan menggunakan arsitektur terdistribusi

六、同类方案对比

| Solusi Kompresi | Rasio Kompresi | Kehilangan Kualitas | Kemampuan Pencarian Teks | Kompleksitas Implementasi |

|---|---|---|---|---|

| Optimasi Struktur PyMuPDF | 10-30% | Tidak ada | Dipertahankan | Rendah |

| Kompresi dengan penurunan kualitas gambar | 30-70% | Jelas | Dipertahankan | Sedang |

| Pengkodean ulang PDF | 20-50% | Mungkin hilang | Mungkin hilang | Tinggi |

七、性能优化建议

- Pemrosesan batch: Gunakan pemrosesan multiproses untuk menangani beberapa file secara bersamaan, meningkatkan efisiensi

- Pemantauan kemajuan: Tambahkan fungsi callback kemajuan untuk meningkatkan pengalaman pengguna

- Kompresi inkremental: Hanya kompres halaman yang berubah dalam PDF, mengurangi operasi berulang

- Mekanisme cache: Catat file yang sudah terkompresi, hindari pemrosesan ulang

八、总结

关键点回顾

- Solusi ini berdasarkan pada empat parameter kunci PyMuPDF:

garbage=4,deflate=True,clean=True,pretty=False, untuk mencapai kompresi PDF tanpa kehilangan; - Keunggulan solusi ini adalah tidak mengorbankan kualitas dokumen, mempertahankan kemampuan pencarian teks, dan mudah diimplementasikan serta memiliki kompatibilitas yang baik;

- Efek kompresi bervariasi untuk berbagai jenis PDF, optimasi terbatas untuk dokumen hasil scan, dan dokumen teks murni yang telah diedit berkali-kali memberikan hasil terbaik.

Solusi kompresi PDF tanpa kehilangan ini mempertimbangkan praktikalitas dan keamanan, dengan kode yang sederhana dan mudah diintegrasikan, cocok untuk sebagian besar skenario pengolahan dokumen. Jika memerlukan rasio kompresi yang lebih tinggi, Anda juga dapat menggabungkan kompresi tanpa kehilangan gambar (seperti mengoptimalkan DPI), tetapi perlu memperhatikan keseimbangan antara efek dan kompleksitas.