【实战】PDF无损压缩:基于PyMuPDF的结构优化方案

【实战】PDF无损压缩:基于PyMuPDF的结构优化方案

Im Arbeitsalltag stoßen wir häufig auf das Problem, dass PDF-Dateien zu groß sind: E-Mail-Anhänge können nicht gesendet werden, Upload- und Downloadgeschwindigkeiten sind langsam, und sie beanspruchen viel Speicherplatz. Traditionelle Komprimierungsmethoden verringern entweder die Bildqualität und führen zu Unschärfe oder wandeln Text in Bilder um, wodurch die Suchbarkeit verloren geht, was einfach nicht akzeptabel ist.

Heute möchte ich eine verlustfreie PDF-Komprimierungslösung vorstellen – eine Optimierung der internen Struktur von PDFs und die Bereinigung redundanter Daten basierend auf der PyMuPDF (fitz) Bibliothek, die sowohl die Dateigröße effektiv reduziert als auch die Textsuchbarkeit und visuelle Klarheit perfekt bewahrt.

一、核心实现原理

Hier ist der Kerncode, der die Schlüssel-Logik zur Optimierung und Komprimierung der PDF-Struktur implementiert:

import os

from pathlib import Path

import fitz # PyMuPDF

def compress_pdf_simple(input_path, output_path=None):

"""

Einfaches PDF-Komprimierungsverfahren - nur Strukturoptimierung (verlustfrei)

Parameter:

input_path (str): Eingabepfad der PDF-Datei

output_path (str): Ausgabepfad der PDF-Datei

Rückgabe:

str: Ausgabepfad

"""

try:

# PDF-Datei öffnen

doc = fitz.open(input_path)

# Intelligente Generierung des Ausgabepfades (wenn nicht angegeben)

if output_path is None:

input_file = Path(input_path)

output_path = str(input_file.parent / f"{input_file.stem}_simple_compressed{input_file.suffix}")

# Kern: Verlustfreie Kompression durch Parameterkombination

doc.save(

output_path,

garbage=4, # Maximale Bereinigung ungenutzter Objekte

deflate=True, # Verwendung des deflate verlustfreien Kompressionsalgorithmus

clean=True, # Bereinigung/Optimierung der internen PDF-Struktur

pretty=False # Kompakte Ausgabe, Entfernen von Leerzeichen

)

# Dokument schließen und Ressourcen freigeben

doc.close()

# Kompressionsinformationen berechnen

original_size = os.path.getsize(input_path)

compressed_size = os.path.getsize(output_path)

compression_ratio = (1 - compressed_size / original_size) * 100

# Kompressionsergebnisse ausgeben

print(f"✅ Einfache Kompression abgeschlossen!")

print(f"📄 Ursprüngliche Datei: {input_path} ({original_size / 1024 / 1024:.2f} MB)")

print(f"📦 Komprimierte Datei: {output_path} ({compressed_size / 1024 / 1024:.2f} MB)")

print(f"📉 Kompressionsrate: {compression_ratio:.1f}%")

print(f"🔍 Textsuchbarkeit erhalten: Ja")

return output_path

except Exception as e:

print(f"❌ Fehler während der Kompression: {str(e)}")

return None

# Beispielaufruf

# compress_pdf_simple("deine_datei.pdf")

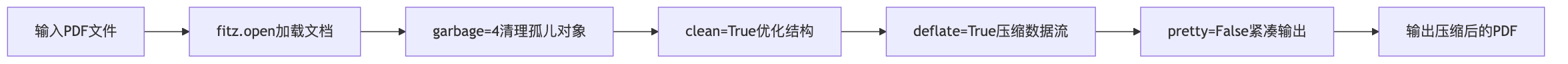

Der Kern dieser Lösung besteht darin, die save()-Methode von PyMuPDF mit vier Schlüsselparametern zu nutzen, um die PDF zu „verschlanken“, ohne den Inhalt des Dokuments selbst zu ändern.

二、关键参数深度解析

2.1 garbage=4:精准清理“孤儿”对象

In PDF-Dateien gibt es viele indirekte Objekte (Seiten, Schriftarten, Bilder, Kommentare usw.), und beim Bearbeiten des Dokuments werden Inhalte gelöscht, ohne dass die zugrunde liegenden Referenzen sofort bereinigt werden, was zu einer Ansammlung von „Waisenkindern“ führt.

| garbage参数值 | 清理程度 | 适用场景 |

|---|---|---|

| 0 | 不清理 | 仅需快速保存,无需压缩 |

| 1 | 清理明显未使用对象 | 轻度优化,优先保证兼容性 |

| 2 | 深度检查引用关系 | 常规优化,平衡效果与安全 |

| 3 | 激进清理 | 对简单PDF文件最大化压缩 |

| 4 | 最大程度清理 | 多次编辑的文档,需先验证完整性 |

作用流程:遍历所有间接对象 → 建立引用关系图 → 删除无引用的对象 → 释放存储空间。 实际效果:多次编辑的文档可减少10-30%体积。

2.2 deflate=True:通用无损压缩算法

Deflate ist der von der PDF-Spezifikation empfohlene verlustfreie Kompressionsalgorithmus (basierend auf LZ77 + Huffman-Codierung), der eine hohe Kompatibilität aufweist und von fast allen PDF-Readern dekodiert werden kann.

Nach der Aktivierung werden diese Objekte komprimiert:

- Seiteninhaltsströme

- Schriftartdatenströme

- Bilddatenströme, die nicht von anderen Algorithmen komprimiert wurden

2.3 clean=True:优化文档结构

PDF besteht aus zwei Teilen: „Dokumentstruktur“ und „Inhaltsströme“. clean=True optimiert speziell den Strukturteil:

- Entfernen von doppelten PDF-Objekten

- Zusammenführen von Referenzen auf denselben Inhalt

- Optimierung der Seitenbaumstruktur

- Bereinigung von redundanten Metadaten

实际效果:多页面文档可减少5-15%体积。

2.4 pretty=False:紧凑输出

PDF ist im Wesentlichen ein binäres Format. pretty=True behält Einrückungen, Zeilenumbrüche und andere Leerzeichen zur Verbesserung der Lesbarkeit bei, während pretty=False alle unnötigen Leerzeichen entfernt, um die Größe weiter zu reduzieren (unterstützt die bereits deflate-komprimierten Dateien, hat aber nur einen geringen Effekt).

三、完整压缩流程

四、技术难点与解决方案

4.1 压缩率 vs 文档完整性

挑战:激进的垃圾回收(garbage=4)可能损坏复杂PDF(含脚本/表单)。 解决方案:

- 压缩前先验证文档完整性

- 加密PDF需先解密再压缩

- 用try-except捕获异常,避免程序崩溃

4.2 保持文本可搜索性

挑战:部分压缩方案会把文本转成图像,导致无法选中/搜索。 本方案优势:

- 不修改文本内容和编码

- 仅优化对象引用关系

- 保留字体对象完整性

- 验证方式:压缩后用PDF阅读器测试文本选择功能

4.3 大文件内存管理

挑战:几百MB的PDF易导致内存溢出。 优化建议:

- 分页处理超大文件

- 及时关闭doc对象释放资源

- 监控内存使用,采用流式处理

4.4 智能生成输出路径

利用pathlib库自动生成路径,保持原文件名+压缩标记,跨平台兼容:

if output_path is None:

input_file = Path(input_path)

output_path = str(input_file.parent / f"{input_file.stem}_simple_compressed{input_file.suffix}")

五、使用场景与效果预估

5.1 适用场景

- 学术文档:arXiv下载的PDF通常含大量冗余信息

- 电子书归档:压缩后节省存储空间

- 文档传输:邮件/云盘上传前预处理

- 批量处理:结合Celery实现自动化压缩

5.2 效果预估

| 文档类型 | 典型压缩率 | 备注 |

|---|---|---|

| 纯文本文档 | 10-25% | 效果最明显 |

| 含大量图片 | 5-15% | 仅靠结构优化 |

| 多次编辑文档 | 20-40% | 垃圾回收效果显著 |

| 扫描PDF | 0-5% | 已是图像格式,优化有限 |

5.3 注意事项

- 备份原文件:压缩不可逆

- 验证内容完整性:压缩后全面检查

- 测试打印效果:避免影响输出

- 大批量处理建议用分布式架构

六、同类方案对比

| 压缩方案 | 压缩率 | 质量损失 | 文本可搜索性 | 实现复杂度 |

|---|---|---|---|---|

| PyMuPDF结构优化 | 10-30% | 无 | 保留 | 低 |

| 图片降质压缩 | 30-70% | 明显 | 保留 | 中 |

| 重新编码PDF | 20-50% | 可能损失 | 可能丢失 | 高 |

七、性能优化建议

- 批量处理:用多进程并发处理多个文件,提升效率

- 进度监控:添加进度回调函数,提升用户体验

- 增量压缩:仅压缩PDF中变化的页面,减少重复操作

- 缓存机制:记录已压缩文件,避免重复处理

八、总结

关键点回顾

- 本方案基于PyMuPDF的

garbage=4、deflate=True、clean=True、pretty=False四个核心参数,实现PDF无损压缩; - 方案优势是不损失文档质量、保留文本可搜索性,实现简单且兼容性好;

- 不同类型PDF压缩效果差异较大,扫描件优化有限,多次编辑的纯文本文档效果最佳。

这个PDF无损压缩方案兼顾实用性和安全性,代码简单易集成,适合大多数文档处理场景。如果需要更高的压缩率,也可以在此基础上结合图片无损压缩(如优化DPI),但需注意平衡效果与复杂度。